1. 서 론

2. 기계학습 알고리즘

2.1 k-최근접이웃(k-Nearest Neighbor, kNN)

2.2 의사결정트리(Decision Tree Analysis)

2.3 앙상블 기법(Ensemble Learning Method)

2.4 서포트벡터머신(Support Vector Machine, SVM)

2.5 다층 퍼셉트론(Multilayer perceptron)

3. 데이터세트 구성

3.1 커터마모데이터 구성

3.2 데이터세트 구성

4. 분석 결과

4.1 모델 성능평가와 하이퍼파라미터 결정

4.2 학습 결과

4.3 학습 결과를 활용한 커터마모 예측

5. 결 론

1. 서 론

굴착면 안정성과 소음, 진동, 분진등의 환경적인 문제가 적어 효율적인 TBM (Tunnel Boring Machine)은 대표적인 기계식 굴착 장비로 다양한 지반 조건에서 널리 사용되고 국내외 터널 공사에서 다수 적용되고 있다. TBM 굴진 현장에서 디스크 커터의 교환은 효율성과 경제성 측면에서 시공에 직접 영향을 주기 때문에, 대상 지반조건에 따른 마모경향을 파악하여 교환 시기를 정확하고 계획적으로 준비하기 위해서 디스크 커터에 대한 마모 관리가 필요하다. TBM 장비의 핵심 부품인 디스크 커터의 유지관리는 마모도, 결손, 박리, 탈락 등에 의해 결정되나, 결손이나 박리는 정량적인 분석과 파악이 어렵다. 일반적으로 디스크 커터의 마모량은 지반조건에 따른 마모지수, 장비 직경, 커터회전수, 굴진속도 등을 고려하여 추정하여 관리하고 있다. 대표적인 실험에 의한 마모 예측 모델로는 세르샤 마모지수(Cerchar Abrasiveness Index, CAI)를 이용하여 커터 수명을 추정하는 미국의 CSM 모델(Colorado School of Mines, Rostami and Ozdemir, 1993)과 세르샤 마모지수와 디스크 커터의 질량과의 상관관계를 이용하는 프랑스 모델(Gehring, 1995)과 커터 수명지수(Cutter Life Index, CLI)와 디스크커터의 기본 수명 시간의 상관관계를 이용하는 노르웨이의 NTNU 모델(Norwegian University of Science and Technology, Bruland, 1998)이 있다. Ko et al.(2014)은 비교적 사용빈도가 높은 Gehring, CSM, 그리고 NTNU 모델을 이용한 디스크 커터 수명 예측 방법을 비교한 결과에서 디스크 커터 수명은 커터헤드의 1회전당 관입깊이에 선형적으로 비례하고, 일축압축강도가 증가할수록 감소하는 경향을 나타나고, Gehring 모델과 CSM 모델은 마모지수로 CAI를 이용하는데, CAI 값이 클수록 디스크 커터의 수명은 감소하는 경향을 보여준다. 이와 같이 실험의 기반을 두는 기존의 디스크 마모 예측 모델들은 예측에 필요한 실험 데이터가 현장별로 하나의 값을 주거나 구하기 어려워 복잡한 지반에서는 예측에 어려움을 가지고 있다. 최근 들어, TBM 의 활용이 증가하면서 더욱 안정적이고 경제적인 굴착이 되기 위해서 굴진 시 획득한 TBM 데이터 분석에 다양한 인공지능 및 머신러닝 기법을 적용하여 TBM 전방의 지반예측, 디스크커터의 마모 및 교환주기 예측, 지반침하예측, TBM 굴진율 및 성능예측 등의 연구가 수행되고 있다(Yagiz, 2008, Kim et al., 2020a, Kang et al., 2021, Yang et al., 2022, Chen et al., 2019, Kim et al., 2022, Yagiz and Karahan, 2011, Armaghani et al., 2017, Jung et al., 2019, Mokhtari and Mooney, 2020, Kang et al., 2020).

La et al.(2019)은 서포트 벡터 머신(Support vector machine)을 이용하여 지반 조건별 디스크 커터의 마모와 높은 상관성을 갖는 TBM 기계 데이터와 디스크 커터 교체 이력을 분류하는 연구에서 디스크 커터의 교체 이력 데이터가 많을수록 분류 예측 결과가 좋아진다는 것을 보여준다.

Kim et al.(2020b)은 현장여건에 따라 다양한 요소를 고려해야 하기 때문에 디스크 커터의 교체시기를 위해서는 머신러닝 기법을 이용한 디스크 커터 교체 유무 예측 모델이 필요성을 강조하고 머신러닝 분류기법 중 서포트 벡터 머신, 최근접이웃(k-Nearest Neighbor) 알고리즘, 의사결정트리(Decision Tree) 알고리즘을 적용하여 디스크 커터 교체 유무를 분류하여 기 위한 비교 연구에서 학습 모델 선정 보다는 지반 조건 및 입력데이터 어떻게 구성하는지가 더 중요하다고 보여준다.

본 연구에서는 TBM 굴진 현장의 지반 조건과 굴진 데이터 간의 영향 분석을 통해 효과적이고 정확한 디스크 커터 마모 예측을 가능하도록, 굴착 중 생성되는 기계 데이터와 지반 데이터를 기반으로 최근에 다양한 분야에서 널리 사용되고 있는 기계학습 회귀 모델인 최근접이웃(k-Nearest Neighbor), 의사결정트리(Decision Tree), 램덤포레스트(Random Forest), 그레디언트 부스팅(Gradient Boosting Machine), XG 부스팅(eXtreme Gradient Boosting), Light GBM(Light Gradient Boosting Machine), 다층 퍼셉트론(Multilayer perceptron)을 활용하여 디스크 커터 마모 예측을 위한 연구를 수행하였다.

2. 기계학습 알고리즘

본 연구에서는 목표변수(target)를 레이블(label)하고 훈련 데이터(training dataset)을 이용해 학습을 진행하는 지도학습(supervised learning)기반 알고리즘을 사용하였다. 또한 슬러리 쉴드 TBM 현장의 커터마모에 대한 예측을 목표로 하고 있으므로 회귀 기법을 사용하였다. 기계학습 기법에는 많은 알고리즘이 있지만, 기본적인 알고리즘인 k-최근접이웃 기법, 의사결정트리 기법과 마진(margin) 최대화를 통해 구조적으로 위험을 최소화하는 기법인 서포트벡터머신, 그리고 알고리즘 결합을 통해 결과를 향상시킨 앙상블 방법 부스팅(Boosting) 기법을 사용하였으며, 인공신경망 기법 중 하나로 딥러닝 기법의 기초적인 방법인 다층 퍼셉트론 기법을 사용하여 학습을 수행하였다. 각 기법에 대한 간단한 설명은 다음과 같다.

2.1 k-최근접이웃(k-Nearest Neighbor, kNN)

기계 학습과 패턴 인식 분야에서 가장 오래되고 많이 사용된 방법이 k-최근접이웃 알고리즘이다(Cover and Hart, 1967). 데이터 샘플에서 유사도가 높은 k개의 가장 가까운 데이터를 골라 다수결의 과반수 의결로 분류하는 방법으로 알고리즘이 단순하고 뛰어난 일반화 성능을 가지고 있다. k-최근접이웃 알고리즘은 학습 데이터의 사이의 모든 거리를 계산하는 쉬운 방식이나 학습 데이터가 매우 클 경우 다량의 계산량으로 인한 학습 속도 저하문제가 있다. K-최근접 이웃 모델은 기계화 학습에서 가장 간단하고 명료한 학습 알고리즘이다.

2.2 의사결정트리(Decision Tree Analysis)

의사결정트리는 주어진 데이터를 분류하고 규칙을 찾는 방법이다. 트리 기반으로 가지 분리하여 변수를 구분하고 영역 만들어 클래스 값을 구한다. 의사결정트리 기법은 연속형, 범주형 변수에 모두 사용 가능하고 차원축소나 변수 선택 등 의사결정 생성과정을 통해 많은 변수 중에서 상대적으로 종속변수에 주는 영향을 파악할 수 있다(Breiman et al., 1984). 트리기법은 그룹별로 특징을 발견하거나 어느 집단에 속하는지 여부를 파악하여 세분화 하는데 효율적인 기법이다. 변수의 정규화나 표준화 같은 전처리가 필요하지 않으며, 특정 변수의 값이 누락되어도 사용 가능하나, 학습데이터에 과대 적합되는 특징 때문에 새로운 데이터에 적용하면 예측 성능이 좋지 않아 일반화가 어렵다는 단점이 있다.

2.3 앙상블 기법(Ensemble Learning Method)

더 좋은 예측 성능을 위해 서로 다른 분류 알고리즘 모델을 생성하고 결합하여 최적의 결과를 추출하는데 활용하는 것을 앙상블 모델이라고 한다. Breiman(1996)에 의해 제안된 배깅(Bagging, Bootstrap Aggregating )은 중복 샘플을 활용하여 다양하게 학습하여 단일 혹은 여러 모델을 병렬적으로 사용하는 모델이고, 대표적인 방법으로 랜덤 포레스트(Random Forest)가 있다. 이와 다르게, Kearns and Valiant(1994)가 처음으로 제안한 부스팅 기법은 단일 모델을 활용하여 순차적으로 학습하고 발생하는 오차를 보안하기 위해 다음 분류기에 가중치를 부여하고 다시 학습을 진행하는 방식이다. Friedman(2001)이 소개한 그레디언트 부스팅(Gradient Boosting Machine, GBM)은 경사하강법으로 가중치를 구해서 최적화된 결과를 얻는 대표적인 부스팅 기법이다. XG Boosting (eXtreme Gradient Boosting)는 GBM 기반의 알고리즘으로 병렬화, 가지치기, 하드웨어 최적화 방법으로 기존 시스템 최적화와 정규화, 결측치 처리 등으로 알고리즘 성능을 향상시키며(Chen et al., 2015), Light GBM (Light Gradient Boosting Machine)은 XG Boosting와 마찬가지로 GBM기반의 알고리즘으로 히스토그램 기반 알고리즘 사용으로 빠른 교육속도와 효율성이 높고, 알고리즘의 수직 확장 방식을 사용하여 복잡한 모델을 만들고 더욱 정확도를 향상시킨다(Ke et al., 2017).

2.4 서포트벡터머신(Support Vector Machine, SVM)

패턴 인식과 자료 분석 등으로 자주 활용되는 서포트 벡터 머신은 기계학습 모델로써 러시아의 수학자 Vapnik(1995)이 제안하였다. 학습자료 특성이 변수들로 표현된다고 할 때, 학습 샘플 자료들을 n 차원의 데이터 공간에 분포시키고 이를 구분하는 최적의 경계를 찾아내는 알고리즘이다. 서포트 벡터의 원리는 데이터들이 가장 가까운 포인트로 이루어진 결정경계 사이의 거리를 의미하는 마진을 갖는데, 그 중에 최대 마진을 갖는 결정경계를 찾는 것이다. 서포트 벡터 머신의 분류는 일정한 마진 오류 안에서 데이터 클래스를 구분하는 폭이 가장 최대가 되도록 하는 경계를 찾는 것이 목표이다.

2.5 다층 퍼셉트론(Multilayer perceptron)

퍼셉트론 이론은 Rosenblatt(1958)에 의해 개발된 인공 신경망의 중 하나로 다수의 입력으로부터 하나의 결과를 보여주는 알고리즘이다. 다층 퍼셉트론은 퍼셉트론을 여러 층 쌓은 순방향의 인공 신경망으로, 입력층(input layer)과 은닉층(hidden layer)과 출력층(output layer)으로 구성된다. 각 층에서는 활성함수를 통해 입력을 처리한다(Rumelhart et al., 1986). 이렇게 여러 층을 쌓으면 분류 성능은 점점 올라가나 그만큼 가중치를 많이 구해야 해서 과정이 복잡해지고 느려진다.

3. 데이터세트 구성

3.1 커터마모데이터 구성

3.1.1 현장 개요 및 지반 정보

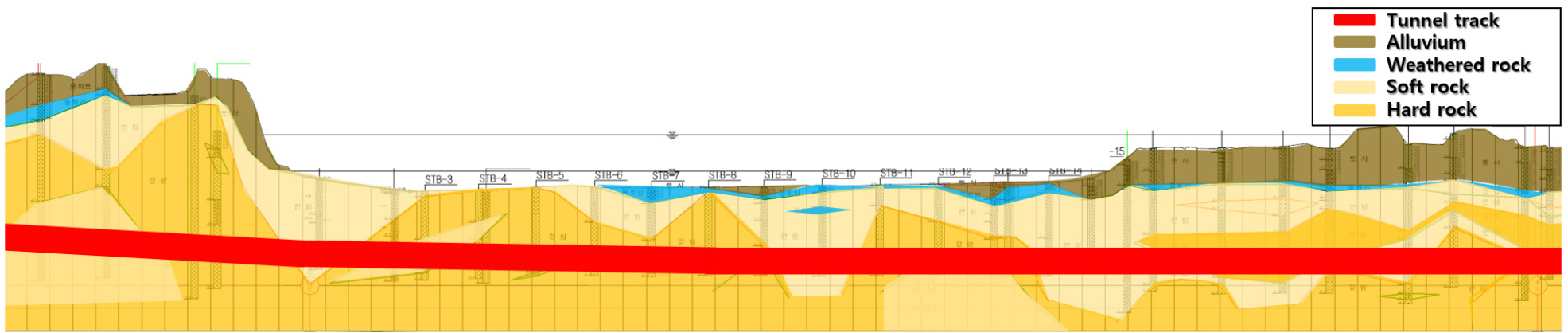

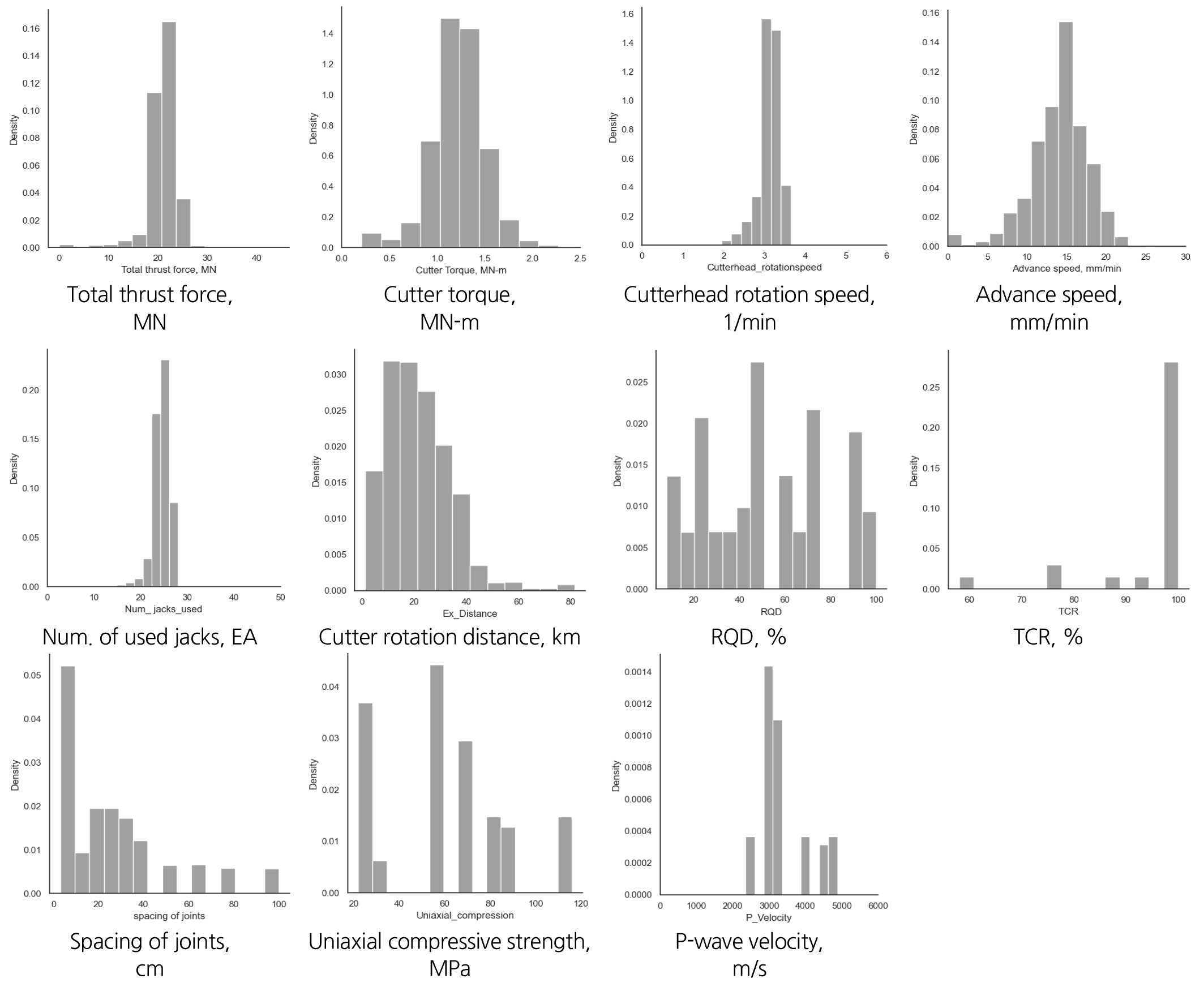

본 연구에서 활용한 슬러리 쉴드 TBM 구간의 지질학적 특성은 편마암 류가 주로 분포하고 화강암과 운모편마암이 일부 관입하고 있으며, 상부에 형성된 충적층의 토질은 실트질 모래 혹은 모래섞인 자갈로 구성되어 있다. 분석에 사용된 지반정보는 터널 설계 시 작성된 지반조사보고서와 터널 종단면도로부터 수집하였고, 자세한 시추 위치와 지층 분포는 Fig. 1에 제시하였다. 터널 부지의 지층은 상부 충적층과 일부 풍화암, 주로 연암과 경암이 혼재된 구성이다. 그리고, 쉴드 TBM 터널 통과 노선은 주로 하저 구간이고, 굴진 대상 지층은 대체로 연암과 경암 구간이다. 터널 설계 당시에 조사된 TBM 터널 구간의 시추 데이터는 총 36개 이고, 해당 시추조사와 암성 물성 시험 결과에서 RQD는 8~100%(평균 51.6), 절리간격(평균)은 3.0~100 cm, 일축압축강도는 21.88~116(평균 60.7) MPa, 탄성파 속도(P wave)는 약 2,300~4,876 m/s(평균 3363.9) 범위로 대체로 양호 암질 구간임을 알 수 있다(Table 2). 본 연구에서는 대상 지반 속 암석의 심도별 측성을 확인할 수 있는 RQD, TCR, 절리간격과 굴진 대상 암석의 강도특성을 나타내는 일축압축강도와 탄성파속도를 마모예측을 위한 분석자료로 사용하였다

3.2 데이터세트 구성

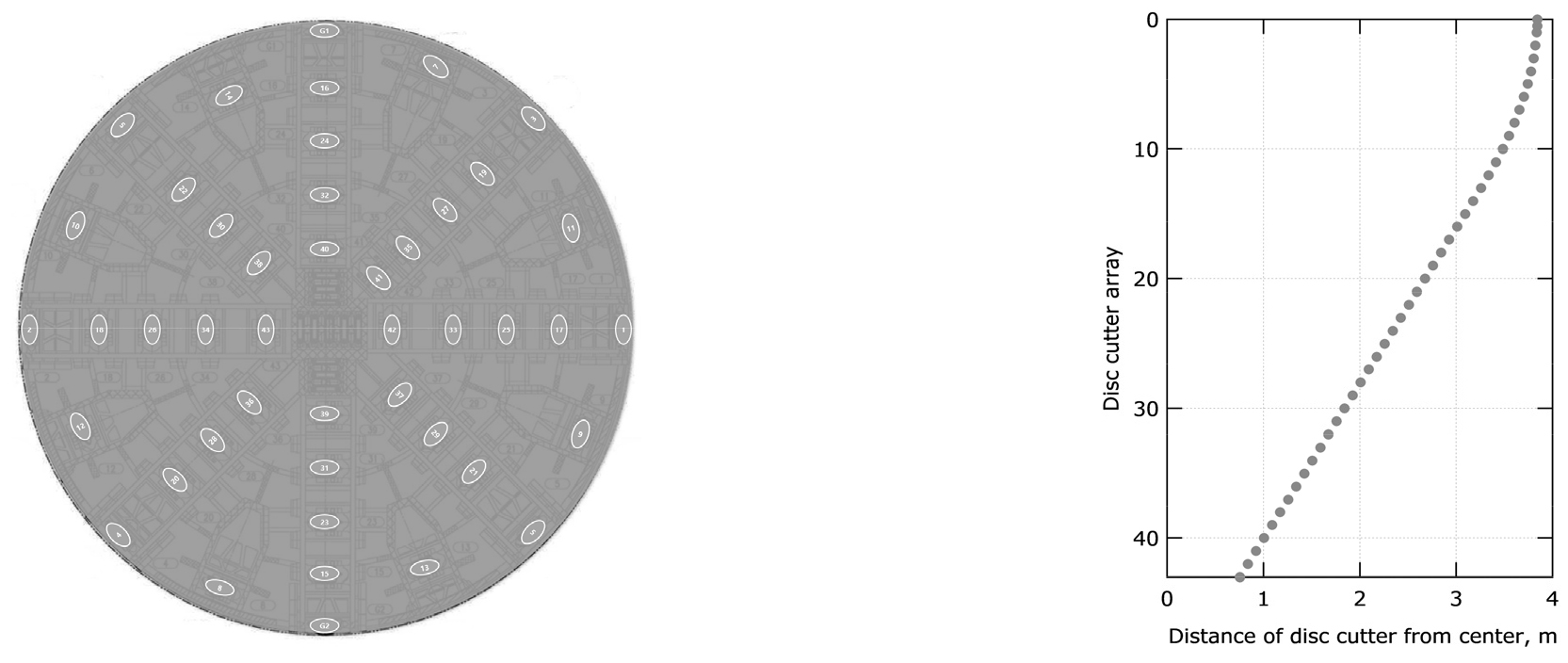

커터 마모 예측 연구의 데이터 구성에 활용된 터널 대상 구간의 지반정보, 노선정보, 실드 TBM 기계 데이터, 커터 마모/교체 데이터 등이 있다. 본 연구에서 사용한 기계 데이터를 얻은 슬러리 쉴드 TBM 장비의 주요 제원은 Table 1와 같다. 장비의 직경은 7.3 m이고, 최대추력은 56 MN, 최대토크는 5.33 MN·m, 최대 RPM은 3.6이다. 굴진 데이터 분석 결과, 사용된 추력의 평균은 20.89 MN으로 장비 최대 성능의 약 37.3%이고, 커터헤드 토크의 평균은 1.22 MN·m로 장비제원 최대 토크의 22.89% 범위에서 주로 사용된 것을 확인할 수 있었다. 굴진 속도는 평균 13.98 mm/min로 최대 약 26 mm/min이하로 안정적인 굴진 중에 사용한 쉴드 잭은 평균 약 24개이고, 커터헤드의 평균 회전속도는 3.08 r/min이다.

Table 1.

Summary of slurry TBM specification

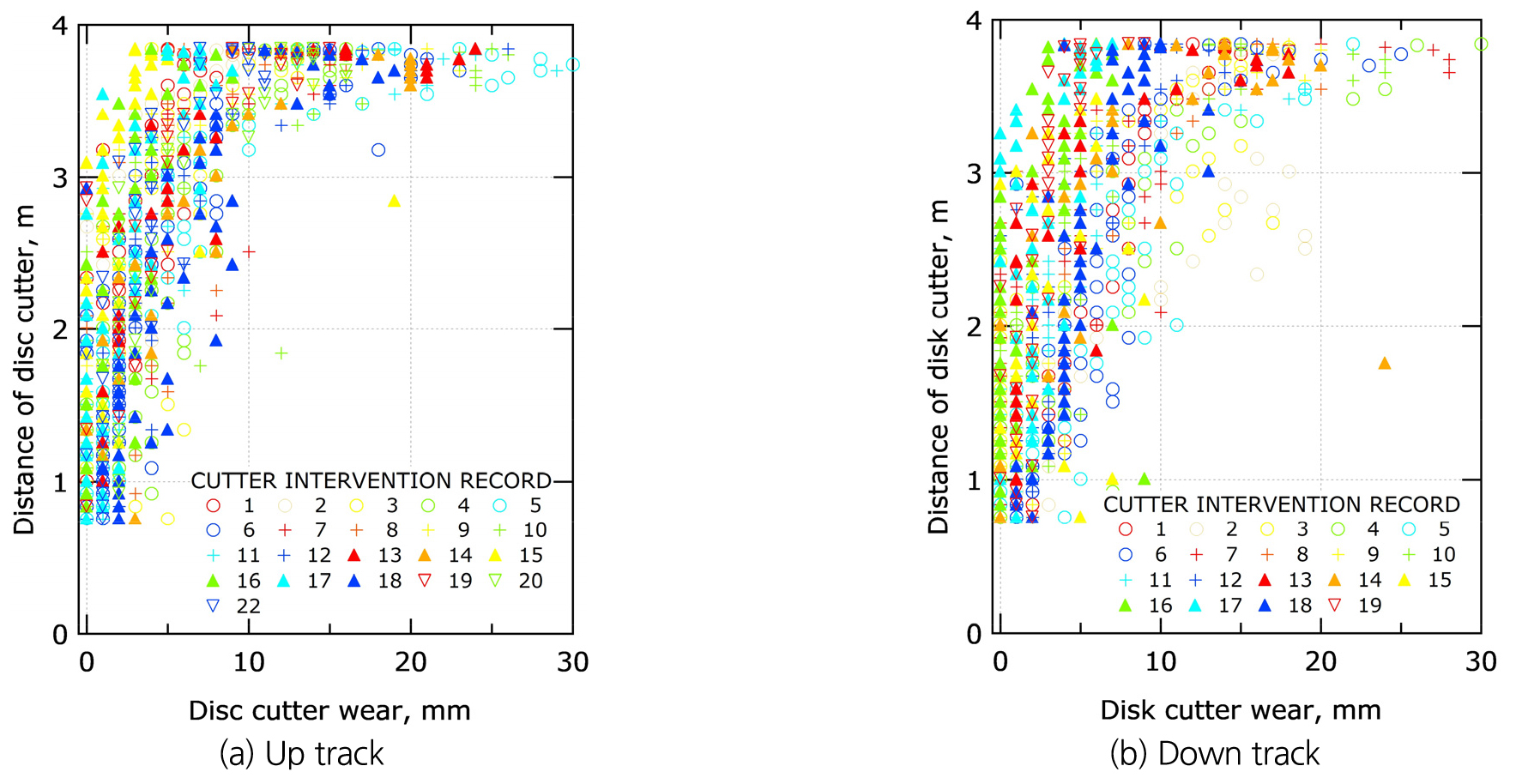

본 연구에서 사용한 쉴드 TBM 굴진 현장의 상행선 21번와 하행선 19번의 디스크 커터 마모 점검에서 측정한 커터 마모 데이터 1800개의 데이터로 구성되어 있다(Fig. 2).본 현장에서 사용된 디스크 커터는 총 45개로 직경이 17 인치이며, 커터 마모 교체 구간별 디스크 커터의 평균 회전 거리는 21.71 km로 나타났다(Fig. 3). 커터 마모 예측 데이터의 분석에 사용된 주요 데이터의 통계학적 특성과 데이터 항목별 분포 특성을 Fig. 4와 Table 2에서 확인할 수 있다.

Table 2.

Statistical description of the database.

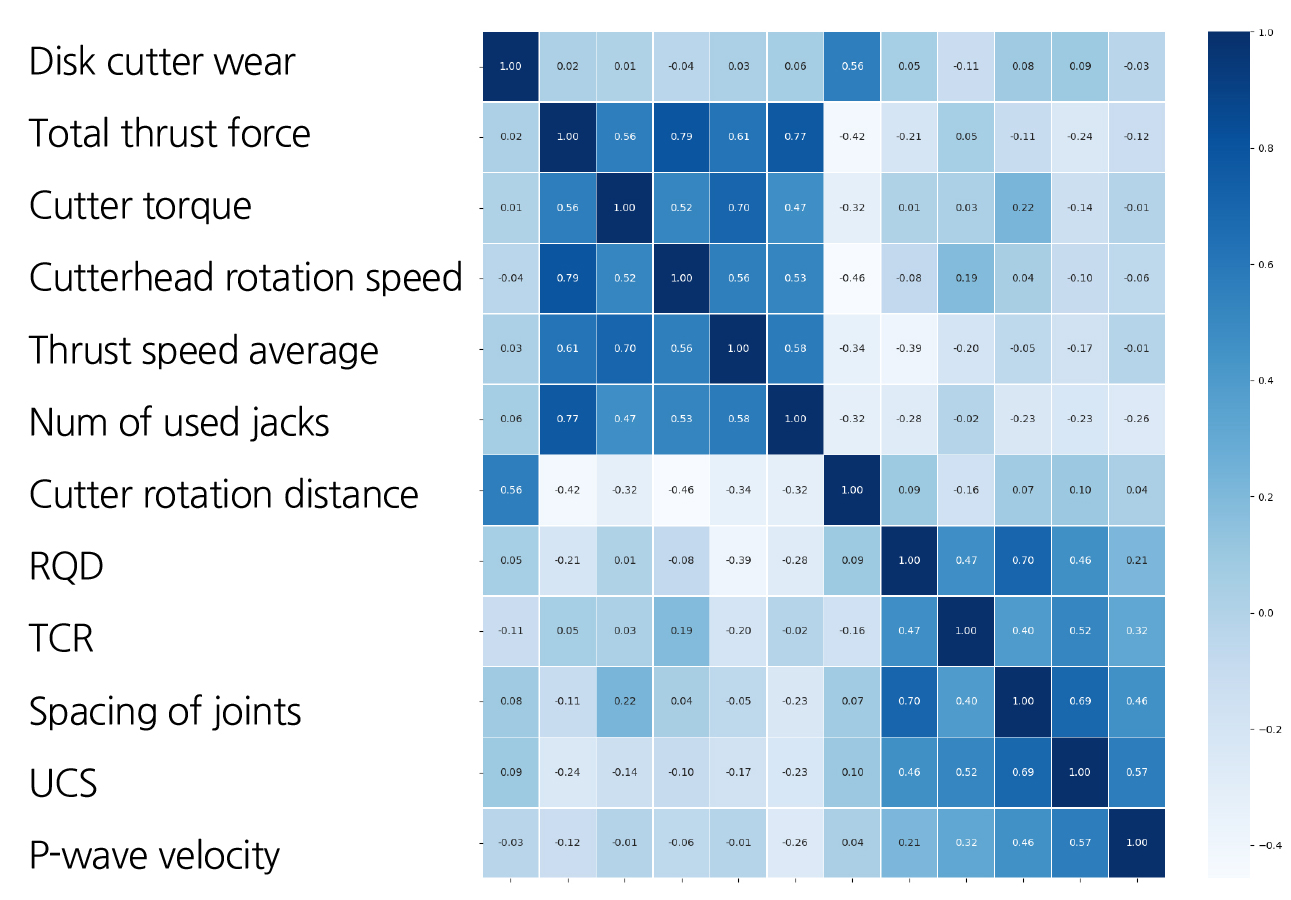

쉴드 TBM 굴진 현장에서는 압력관련 변수, 속도 관련 변수, 온도 관련 변수, 위치/방향 관련 변수, 굴진 시간이력 관련 변수 등 광범위한 기계 데이터 수 천개가 생성될 수 있으며, 학습 대상 현장에서는 약 1000여개가 기록되었다. TBM의 굴진 데이터를 기반으로 정확하고 효과적인 커터마모 예측을 위해서는 목표에 맞는 특성변수 항목의 선택과 선택된 데이터의 처리가 무엇보다 중요하다. 본 연구에서는 굴진 데이터에서 디스크 커터 마모 예측에 기여하지 않는 다양한 전압 측정값, 계측 온도, 위치 및 자세 정보와 같은 특성변수를 분석에서 제외하였다. 통계적인 분석에서 각 특성 변수의 전체 데이터를 25% 단위로 나눌 때에 Q1(1 사분위수), Q2(2사분위수), Q3(3사분위수)로 나타낼 수 있으며, 그 결과로 데이터 분포 특성과 이상치 판단을 할 수 있다. Fig. 4에서 변수의 통계적 분포가 양호한 특성변수를 먼저 선택하고, Fig. 5에서 상관관계 검증을 통해 특성변수를 확인하였다. 최종적으로 디스크 커터 마모 예측에서 주요 기계데이터인 총 추력(total thrust force), 커터토크(cutter torque), 커터헤드 회전속도(cutterhead rotation speed), 굴진속도(thrust speed average), 사용 잭본수(Num. of used jacks), 디스크커터 회전거리(cutter rotation distance)와 대상 지반정보인 RQD, TCR,절리간격(spacing of joints), 일축압축강도(Uniaxial compressive strength, UCS),탄성파속도(p-wave velocity)를 특성변수로 선정하였다.

그리고 수집된 전체 굴진 데이터 중에서 상행 22번, 하행 19번의 디스크 커터 점검기록에 해당하는 마모 교체 구간을 기반으로 기계데이터와 대상 지반정보를 매칭하여 데이터세트(dataset)로 구성하였다. 터널 설계 시 지반조사에서 획득한 시추데이터에서 TBM 노선이 통과 위치(level)와 터널 직경(7.3 m)에 해당하는 지반 정보를 사용하여 데이터세트를 구성하였다. 본 연구에서는 데이터 전처리(pre-processing) 과정인 피처 스케일링(feature scaling)으로 피처의 최소값을 0, 최대값을 1로 변환하여 데이터는 0~1사이에 존재하나 분포는 유지하는 min-max 스케일링을 적용하였고, 결측치와 이상치는 인근 데이터 값의 평균값으로 대체하는 방식을 사용하였다.

4. 분석 결과

4.1 모델 성능평가와 하이퍼파라미터 결정

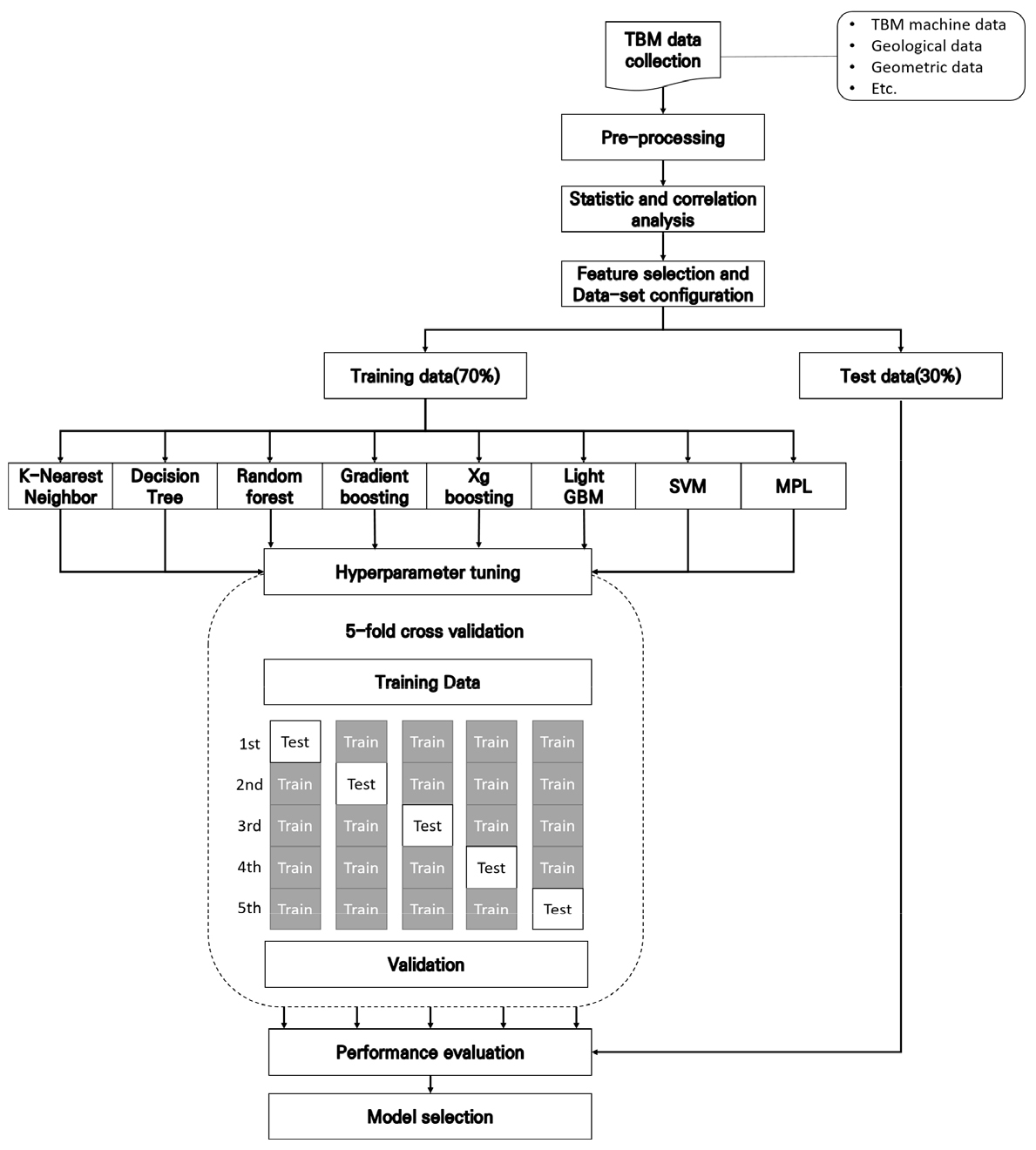

커터마모 예측을 위한 회귀 모델 구축을 위한 데이터 분석을 위해 앞서 2.2절에서 언급한 지도학습 기반 알고리즘으로 본 연구에서 사용된 알고리즘은 단일 기법으로는 k-최근접이웃 기법, 의사결정트리 기법과 서포트벡터 기법이 있고 앙상블 기법(Ensemble Learning Method)으로는 대표적인 배깅 기법인 랜덤포레스트와, 약학습기(weak learner)를 활용하는 대표적인 그레디언트 부스팅과 그레디언트 부스팅의 느린 학습 속도와 과적합 문제를 보안한 XG 부스팅, Light GBM가 있다. 그리고, 인공신경망 기법 중에 기초적인 다층 퍼셉트론 기법을 선정하였다. 자료 분석과 기계학습에는 파이썬 3.8(python 3.8) 프로그램과 오픈 소스 라이브러리를 사용하였으며, 사용한 구체적인 분석과정과 학습 절차는 Fig. 6과 같다

학습 모델의 적합성을 평가하기 위해서 학습 데이터와 테스트 데이터를 7:3 비율로 무작위로 조합하여 적용하였다. 회귀 모델의 예측성능을 평가하는 방법으로는 평균오차제곱에 루트를 더하여 실제 관측 값과 차이를 확인할 수 있는 RMSE (Root Mean Squared Error)와 예측 모델이 주어진 자료와 얼마나 적합한가를 평가하는 척도인 결정계수(R2, coefficient of determination)를 사용하였다. 결정계수는 1에 가까울수록 선정된 회귀 모델이 설명력이 높음을 알려준다(Table 3).

Table 3.

Performance measures of regression prediction

| Definition of the terms | Formulas for measuring performance |

| MSE: Mean Squared Error | |

| RMSE: Root Mean Squared Error | |

| R-squared: Coefficient of determination |

하이퍼파라미터(hyperparameter)는 머신러닝 모델을 만들 때 직접 조정해주는 값으로 최적의 훈련 모델을 구현하기 위해 결정하는 변수이다. 데이터 훈련 과정에서 알고리즘 모델에 적합한 파라미터를 조합을 찾기 위한 하이퍼파라미터 튜닝(hyperparameter tuning)을 할 수 있으며, 이는 알고리즘을 모델링에서 성능에 영향을 줄 수 있는 하이퍼파라미터에 대해서 최적에 가까운 값을 찾기 위한 조정 작업이라 할 수 있다.

본 연구에서는 커터 마모 예측의 학습 결과가 일부 데이터에 과적합(overfitting)되는 것을 방지하기 위해 분할 교차 검증(k-fold cross validation)을 적용하였다. 분할 교차 검증은 앞서 7:3로 분할된 학습 데이터(training data)를 다시 k 묶음으로 나누어 학습 데이터와 테스트 데이터를 k개 구성하여 k번 학습을 반복하고 k번의 학습 결과를 평균을 내여 편향되지 않는 최종 성능을 구하는 방법이다(Fig. 6). 본 연구에서는 5겹 교차 검증(5-fold cross validation)의 성능비교를 통해 가장 좋은 성능을 내는 하이퍼파라미터 조합을 찾는 그리드서치(GridSearchCV) 튜닝 방법을 사용하여 커터 마모 예측 학습모델에 대해 적절한 파라미터를 결정하였다(Table 4).

Table 4.

Summary of hyperparameter for regression models

4.2 학습 결과

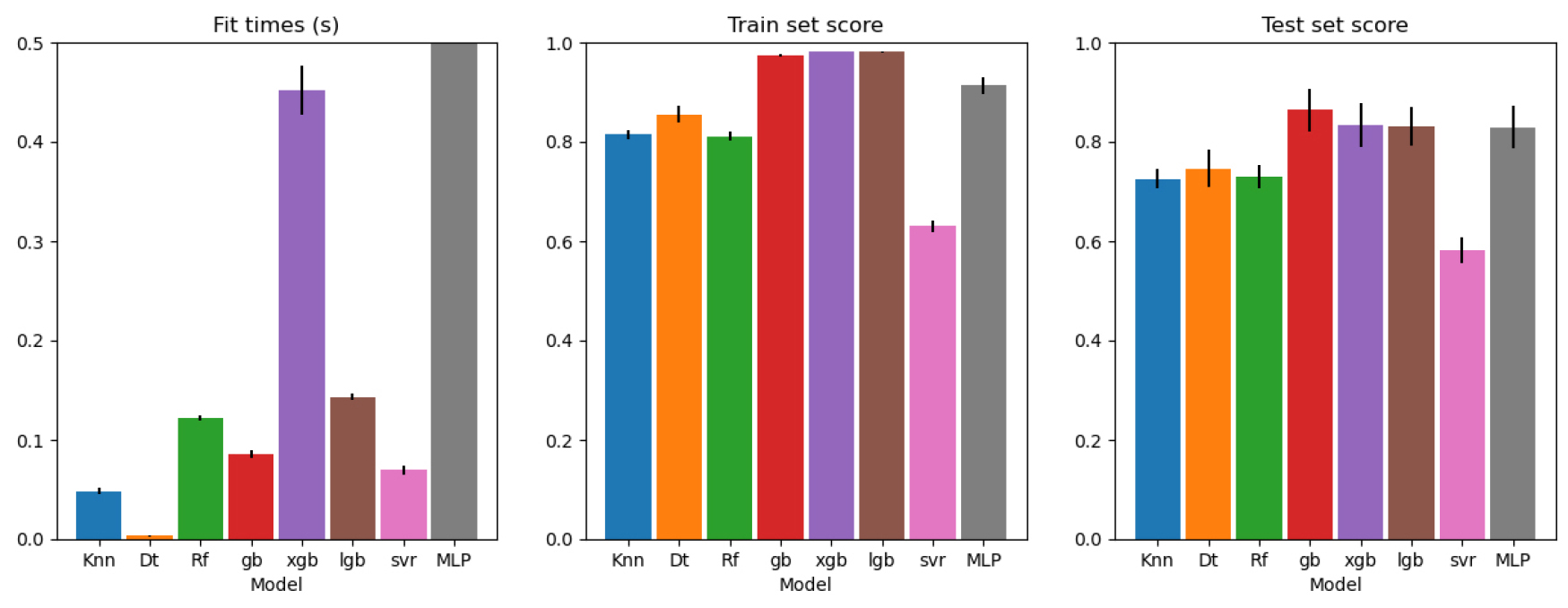

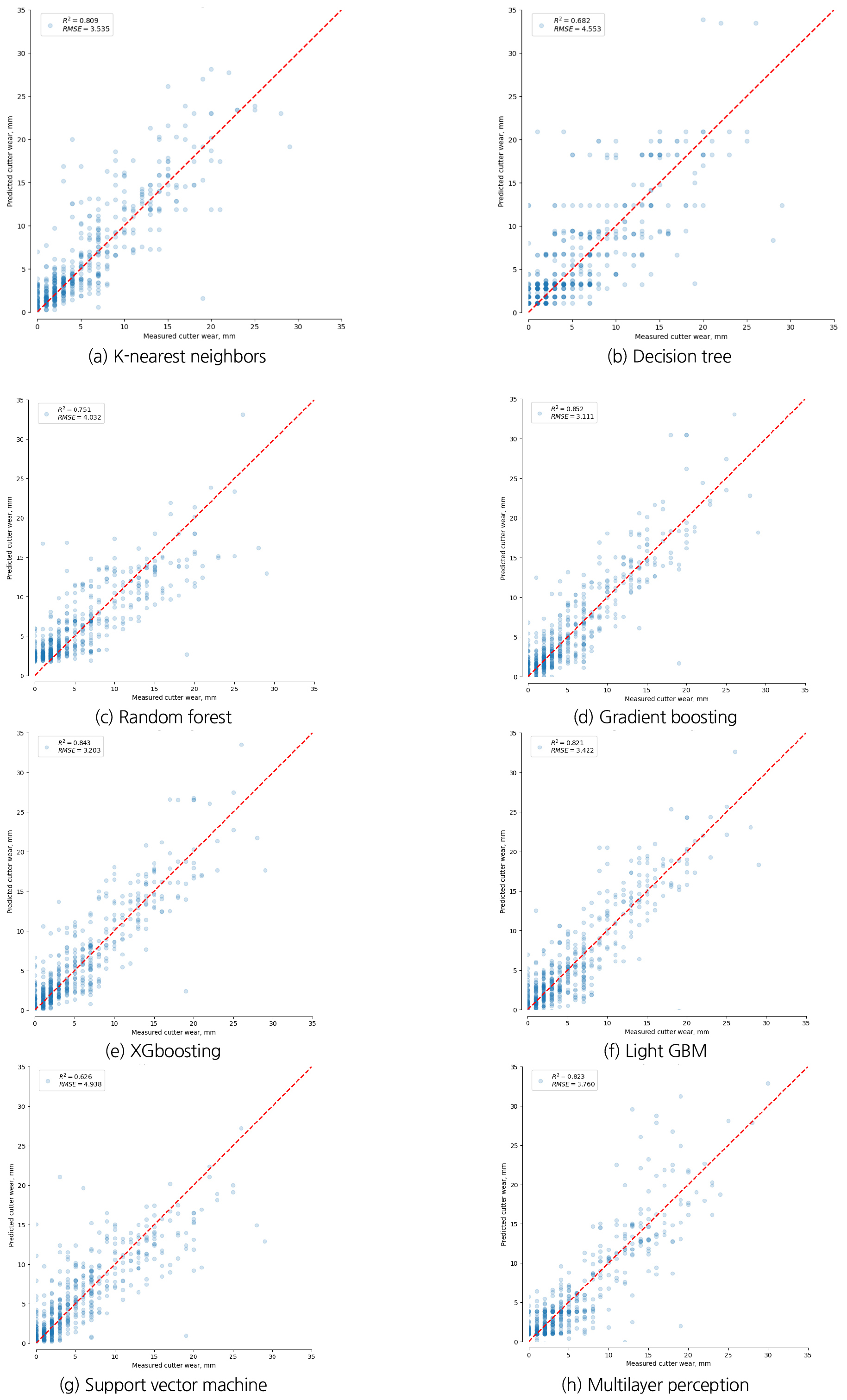

본 연구에서는 슬러리 쉴드 TBM 굴진 데이터, 디스크 커터 마모 데이터, 지반정보를 기반으로 8개의 기계학습 알고리즘을 이용하여 학습을 수행하였다. 학습 모델의 적합성을 나타내는 결정계수는 1에 가까울수록 예측성능이 우수하고 RMSE는 오차를 나타내므로 작을수록 오차가 작아 예측성능이 우수하다는 것을 의미한다. 커터마모 예측을 위한 기계학습 알고리즘 모델을 이용한 분석결과를 Table 5, Fig. 7과 Fig. 8에 정리하였다.

Table 5.

Evaluating the performance of regression models for shield TBM datasets

k-최근접이웃과 의사결정트리, 랜덤 포레스트, 서포트벡터 머신의 경우 결정계수가 학습 세트(70%)에서의 0.602~0.751, 테스트 세트(30%)에서 0.627~0.809 정도이고, RMSE가 3.28~5.037 정도로 예측 성능이 크게 좋다고도 할 수 없다. 앙상블 모델 중 부스팅 계열인 그레디언 부스팅, XG 부스팅, Light GBM의 결정계수가 학습 세트(70%)는 0.834~0864, 테스트 세트(30%)는 0.821~0.852이고, RMSE값도 1.293~3.422로 나타나서 예측성능이 높은 것을 확인할 수 있다. 마지막으로 다층 퍼셉트론의 경우 결정계수가 학습 세트(70%)에서는 0.941, 테스트 세트(30%)에서는 0.823이고 오차인 RMSE 각각 2.067, 3.760로 예측성능이 좋아 보이지만 학습 세트와 테스트 세트 간의 성능차이가 있는 것을 알 수 있다.

본 연구에서 사용한 슬러리 TBM 의 커터마모 예측 모델에 대한 최종 분석 결과에서 8가지 예측 모델의 성능을 비교해보면 앙상블 모델 중 부스팅 계열인 그레디언트 부스팅, XG 부스팅, Light GBM 모델이 분석한 데이터세트에 대해서 쉴드TBM 커터 마모예측에서 좋은 성능을 보인 모델임을 알 수 있다.

테스트 세트의 성능 측면에서만 보면 의사결정트리, 랜덤 포레스트 서포트벡터을 제외하고 모두 비슷한 성능을 보였다. 그러나 각 모델의 전산자원 소모량과 학습속도 측정 측면을 고려할 필요가 있어, 보통은 조정해야 할 하이퍼파라미터 숫자와 모델별 특성에 따라 속도차이가 있지만 동일한 컴퓨터로 모든 학습 모델에 대해 진행한 분할 교차 검증으로 평가해본 결과에서 다층 퍼셉트론, XG부스팅,그레디언트 부스팅, 랜덤 포레스트, 서포트벡터, k-최근접이웃 모델 순으로 학습 진행 속도가 빠른 것으로 확인되었다(Fig. 7). 최종적으로, 학습 세트(70%)로 이루어진 분할 교차 검증 결과(Fig. 7)와 학습세트(70%), 테스트 세트(30%) 성능평가 결과(Table 5)를 살펴보면, 교차검증 과정에서는 전반적으로 기계학습 모델 성능이 학습 세트에서 테스트 세트보다 높게 나오는 것을 알 수 있다. 이는 학습에 사용한 데이터가 부족하여 학습 모델 결과가 학습 세트에 다소 과적합을 한다고 판단된다. 다만, 최종 모델 평가에서 부스팅 계열 모델이 학습 세트와 테스트 세트의 성능이 비슷한 것을 알 수 있다(Table 5).

4.3 학습 결과를 활용한 커터마모 예측

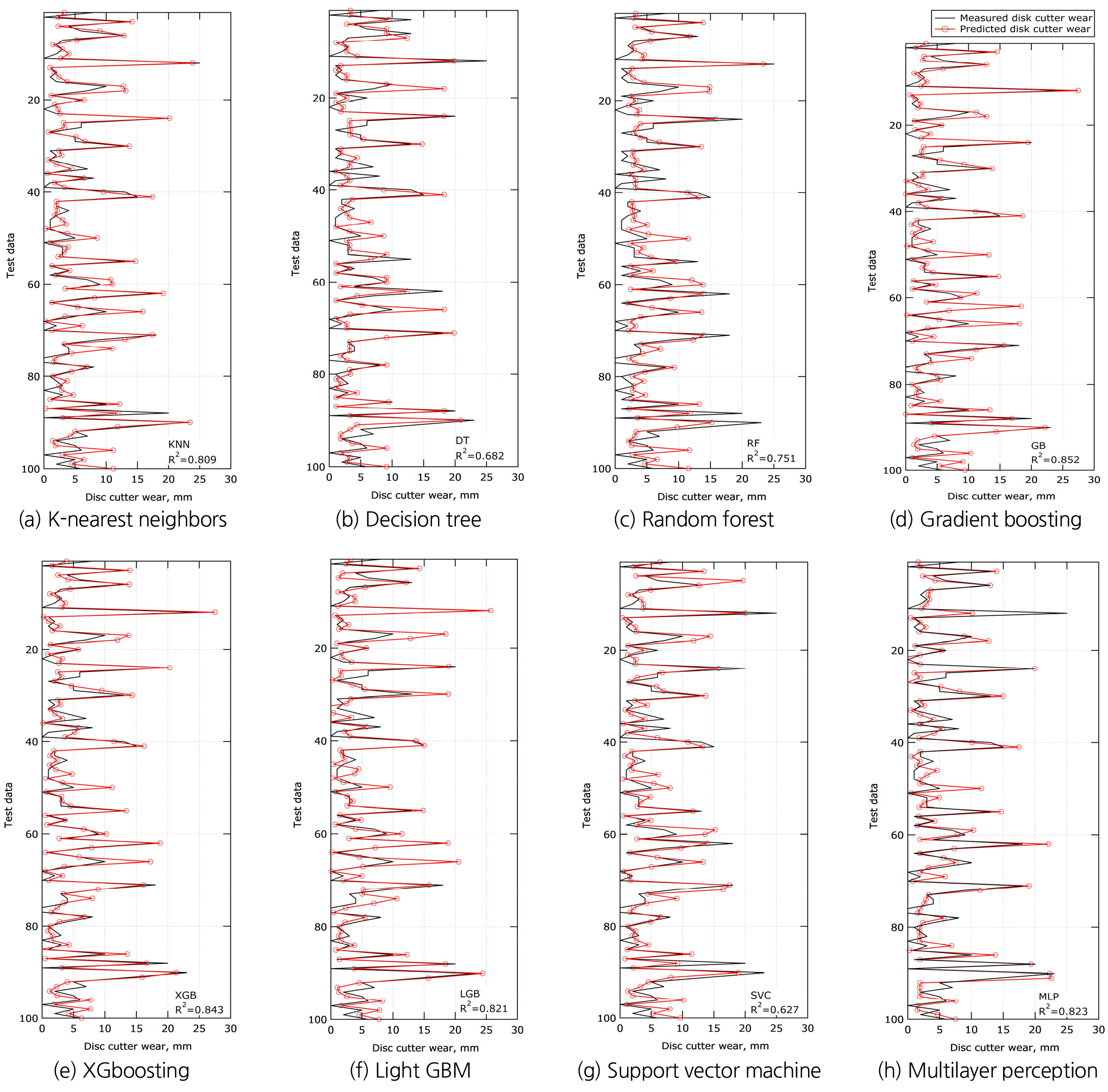

앞서 4.2절에서는 커터 마모 측정값을 대상으로 지반조사와 굴진 데이터를 활용하여 슬러리 쉴드 TBM 디스크 커터 마모 예측을 수행하였다. 학습 결과로 데스트 세트를 대상으로 디스크 커터 마모 예측 모델을 사용하여 마모 예측을 하였다. Fig. 9는 8가지 기계학습 모델의 학습 결과 활용한 예측값과 디스크 커터 마모의 측정값을 비교한 결과이다. 의사결정트리, 랜덤 포레스트 서포트벡터을 제외하고 모두 비슷한 결과를 보여주지만, 앙상블 모델 중 부스팅 계열인 그레디언트 부스팅, XG 부스팅, Light GBM 모델의 결정계수가 각각 0.852, 0.843,0.821로 좋으며 디스크 커터 마모 예측값과 측정값의 차이가 적을 것으로 나타난다(Fig. 9).

5. 결 론

본 연구에서는 슬러리 쉴드TBM 디스크 커터 마모 데이터에 지반정보와 굴진정보를 기반으로 기계학습을 사용하여 디스크 커터 마모 예측을 하였다. 디스크 커터 마모 데이터를 대상으로 8개의 기계학습 회귀 알고리즘을 적용한 학습을 통해 각 모델에 적합한 하이퍼파라미터를 선정하였으며, 분류 모델 결과를 토대로 최적 모델을 도출하는 연구를 수행하였다.

특성변수의 분포특성과 변수 간 상관도 분석을 통해 기계정보인 추력, 커터토크, 커터헤드 회전속도, 굴진속도(thrust speed average), 사용된 잭 수량, 디스크커터 회전거리와 지반정보인 RQD, TCR,절리간격, 일축압축강도,탄성파속도(p-wave velocity)를 최종 변수로 선정하고 하저구간을 통가하는 쉴드 TBM이 상하행 굴진 시 측정한 마모 데이터 각각 21개, 19개의 교체구간에서 디스크 커터 마모 측정값 1,800개를 기반으로 데이터 세트를 구성하였다. 그리고, 학습 모델의 검증을 위해 학습 데이터와 테스트 데이터를 7:3 비율로 나눠서 기계 모델학습 성능평가를 하였다.

분할 교차 검증(5-fold cross validation) 기반의 그리드서치(GridSearchCV) 튜닝 방법으로 성능비교를 통해 8개의 학습 모델이 가장 좋은 성능을 내는 하이퍼파라미터 조합을 결정하였으며, 최종 학습 모델 평가에서 앙상블 모델의 부스팅 계열인 그레디언트 부스팅, XG 부스팅, Light GBM 모델이 결정계수 0.821~0.852, RMSE 3.111~3.402로 좋은 성능을 보여주는 것을 확인하였다.

하지만, 학습 세트(70%)로 진행된 5 분할 교차 검증 과정에서 본 연구에 사용된 8개의 기계학습 모델의 성능이 학습세트(R2: 0.62~0.94)에서 테스트 세트(R2: 0.61~0.85)보다 높게 나타는 것은 다소 학습 데이터가 부족하여 분할 검증 과정에서 학습 데이터에 과적합하는 경향을 보인 것으로 판단된다. 본 연구의 결과는 단일 현장에서 측정된 디스크 커터 마모 데이터를 기반으로 도출된 것으로 추후 다양한 현장에서 측정된 디스크 커터 마모 데이터를 추가 학습하여 예측 성능의 일반화를 강화하고 검증할 필요가 있다.