1. 서 론

2. 자율주행 로봇의 개발 방법

2.1 자율주행 로봇의 하드웨어 구성

2.2 ROS 시스템 구성

2.3 SLAM 기술을 활용한 2차원 지도 작성

2.4 AMCL 기법을 활용한 위치추정

2.5 모바일 로봇의 자율주행 시스템 구성

3. 실내 주행 실험 방법

3.1 실내 실험장 구성

3.2 주행 실험 방법

4. 실험 결과

5. 결 론

1. 서 론

지능형 모바일 로봇이란 외부 주행환경을 스스로 인지(perception)하고 향후 동작을 자체적으로 계획(planning)하여 자율적으로 제어(control)하는 로봇을 뜻한다(Jeong et al., 2013). 1970년 소련의 달 탐사용 로버 ‘Lunokhod’가 발표된 이후로 다양한 로봇들이 개발됐으며, 2003년 미국 NASA에서 화성 탐사용 로봇 ‘Spirit’ 활용되면서 그 관심이 점점 커졌다(NASA, 2022). 지능형 모바일 로봇은 전기 공학, 기계 공학, 컴퓨터 공학 등 다양한 분야의 기술들이 융합된 형태로 개발되어 오고 있으며 물류(Kassai et al., 2020), 농업(Cantelli et al., 2019), 국방(Reis et al., 2021) 등 다양한 분야에서 활발하게 연구되고 있다.

광업 분야에서도 지능형 모바일 로봇을 활용한 연구들이 수행되고 있다. 특히, 지하광산 환경에서 자율주행 로봇을 활용하여 탐사하려는 연구들이 많이 수행되었다. 인간이 접근하기 위험한 지역에 로봇이 대신 탐사함으로써 작업의 안전성을 향상시킬 수 있고, 반복적인 탐사 작업을 자동화하여 생산성도 향상시킬 수 있기 때문이다. 지하광산 탐사에 지능형 로봇을 활용한 사례 중 Zhao et al.(2017)은 지하 석탄 광산에서 사고가 발생하였을 때, 인명구조를 위해 활용될 수 있는 로봇을 개발하였다. 개발된 로봇은 장거리 무선 통신을 통해 사고 현장의 상황이나 유해가스 농도 등을 실시간으로 모니터링할 수 있고, 장애물이나 전선 등을 제거할 수 있는 기능을 탑재하였다. Neumann et al.(2014)은 지능형 모바일 로봇에 거리를 측정할 수 있는 라이다 센서를 탑재하여 지하광산의 3차원 갱도 측량 자동화 시스템을 개발하였다. 개발된 시스템은 로봇이 자체적으로 위치를 인식하고 해당 지점의 3차원 포인트 데이터를 융합하여 갱도의 형태를 측량하였다.

최근에는 국내 광업 분야에서도 지하광산 환경에서 자율주행 로봇을 활용한 연구들이 일부 수행되고 있다(Kim and Choi, 2020a). Kim and Choi(2019)는 라이다 센서를 활용한 지하광산용 소형 자율주행 로봇을 개발하고 실내 실험을 수행하였다. 또한, 후속 연구에서 개발된 자율주행 로봇을 실제 지하광산 현장을 대상으로 주행 테스트를 수행하는 등의 연구도 수행하였다(Kim and Choi, 2020b). 그러나 기존 국내에서 수행된 연구사례들은 로봇이 주행할 때, 라이다 센서를 통해 좌, 우측 벽면의 형태를 인지하고 벽면을 따라 주행하는 벽면 추종(wall-following) 방법으로 주행하였기 때문에 교차로 같은 곳에서는 추가적인 정보가 없을 경우 계획된 경로를 벗어나게 되고 전역지도 없이 주행하기 때문에 여러 지점의 경유지를 설정하고 복귀하는 형태의 경로를 계획하기 어려웠다. 또한, 지하광산에서는 교차로가 많이 있고 광물을 적재하는 지역에 도착한 후 복귀하는 경로의 주행이 필수적이기 때문에 기존에 개발된 시스템은 활용도가 떨어진다는 한계점이 있었다.

본 연구의 목적은 사전에 생성된 전역 지도를 통해 경유 지점을 설정하고 경유 지점들을 순차적으로 주행하고 복귀하는 지하광산용 자율주행 로봇을 개발하는 것이다. 개발을 위해 오픈 소스형 개발 시스템 ROS (Robot Operating System)을 활용하여 통합 플랫폼을 설계하였고 자율주행을 수행하기 위해 위치추정, 장애물 회피, 경로계획 등의 기능을 구현하였다. 개발된 자율주행 로봇을 활용하여 지하광산 환경을 모사한 실내 실험지역을 대상으로 여러 지점의 경유지를 설정하고 경로를 계획하는 실험을 수행하였다. 또한, 실험 결과 데이터 및 주행 영상을 분석하여 위치추정, 장애물 회피 등의 성능을 평가하였다.

2. 자율주행 로봇의 개발 방법

2.1 자율주행 로봇의 하드웨어 구성

Fig. 1은 본 연구에서 개발한 자율주행 로봇의 하드웨어 및 통신 시스템을 나타낸다. 주행 플랫폼에 메인 컨트롤러 역할을 하는 노트북PC와 센서들(모터 엔코더, 카메라, 라이다)을 탑재하였고, 원격 컨트롤러 및 원격 조종기를 무선 통신으로 연결하였다. 주행 플랫폼으로는 Agilex Robotics의 Scout-mini (Agilex Robotics, 2022)를 사용하였다. 여기서 카메라는 Intel의 D435i 카메라(Intel, 2022)를 사용하였고, 라이다는 SICK의 LMS-111 센서를 사용하였다(SICK, 2022). 메인 컨트롤러의 경우 Intel Core i7-9750H, 4.50GHz, 16GB RAM, NVIDIA GeForce 1650 사양의 노트북 PC를 사용하였고 메인 컨트롤러의 화면을 실시간으로 동기화 하는 원격 컨트롤러는 Intel Core i5-10210U, 1.6GHz, 8GB RAM, NVIDIA MX250 사양의 노트북 PC를 사용하였다.

Table 1은 Scout mini 로봇의 사양을 보여준다. 4개의 바퀴와 서스펜션이 각각 움직이는 형태로 작동되며 적재하중이 20 kg 이기 때문에 광산 내부를 탐사할 때 활용될 수 있는 센서들을 탑재할 수 있다. 또한, 로봇이 제자리에서 회전할 수 있으므로 광산 내부에서 좁은 갱도를 주행하거나 막다른 길을 만났을 때, 효율적으로 복귀할 수 있다는 장점이 있다. 또한, 차체가 바닥에서 약 10 cm가량 띄어져 있어서 일부 소형 장애물들은 회피 없이 지나갈 수 있다. 최대 구동 시간이 2시간이고 1회 충전으로 이동할 수 있는 거리가 10 km이기 때문에 광산 내부를 순차적으로 탐사하고 복귀하는 데 적합하다.

Table 1.

Specifications of driving platform used in this study

2.2 ROS 시스템 구성

본 연구에서는 다지점 경유 및 복귀 기능을 탑재한 자율주행 로봇을 개발하기 위해 ROS (Robot Operating System)를 사용하였다. ROS란 로봇 간의 데이터 전송, 가시화, 통신, 하드웨어 연결 등을 수행할 수 있는 오픈소스형 플랫폼이다. 지능형 로봇 개발을 위해 ROS를 활용할 경우 가시화, 시뮬레이션, 디버깅과 같은 작업을 쉽게 수행할 수 있고 위치추정, 자율주행 등에 필요한 라이브러리 등을 쉽게 활용할 수 있다는 장점이 있다. ROS는 연산을 수행하는 노드, 노드 간의 데이터 전송을 수행하는 메시지 등으로 구성되며 주행 플랫폼, 센서, 메인 컨트롤러에서 유동적으로 데이터를 교환할 수 있다. 이때, 노드들 사이에 통신 채널을 토픽(topic)이라고 한다. Table 2는 본 연구에서 자율주행 로봇을 구성하는 ROS 토픽 중 일부를 나타낸다.

Table 2.

Some of the ROS topics that make up autonomous driving robot developed in this study

모바일 로봇과 센서들은 3차원 공간에서 각각의 위치와 방향을 가지며 이는 각각의 좌표계로 표현될 수 있다. 이를 하나의 3차원 공간에서 표현하기 위해서는 좌표계 간의 연결이 필요하다. ROS 환경에서는 TF (transform)를 통해 이를 수행한다. Fig. 2(a)는 모바일 로봇을 구성하는 좌표계 간의 관계도를 나타낸다. 전역 지도를 의미하는 map의 좌표계와 로봇의 현재 위치를 나타내는 odom 좌표계가 연결되며 로봇의 베이스 위치에 연결되는 base_link와 연결된다. 이후 로봇의 전, 후방 바퀴들이 연결되며 바닥에 대한 로봇의 위치를 나타내는 base_footprint도 함께 연결된다. 이외에도 라이다 센서, 카메라 등의 센서들도 각각의 좌표계를 가진다. Fig. 2(b)는 3차원 환경에서 각각의 좌표계들이 연결된 상태로 가시화된 로봇 모델을 나타낸다.

Fig. 3은 ROS 환경에서 자율주행 기능을 수행하기 위한 move_base 패키지의 구성도를 나타낸다. move_base 패키지는 크게 4개의 기능으로 구성된다. 우선, 실시간으로 전역 지도를 불러오고(map_server) 실시간 업데이트(map_update) 기능이 있다. 또한, 업데이트된 지도를 바탕으로 로봇의 전체적인 이동 가능 경로를 지정하는(move_base_global_costmap) 역할과 실시간으로 로봇 전방의 환경 중 주행 가능 영역을 포함하는 기능(move_base_local_costmap)이 있다. 또한, 전방환경에 인지된 상태에서 전체적인 이동 경로를 계획(Navfn_planner) 및 세부적인 이동 경로를 계획(Base_local_planner)한다. 주행 가능 영역과 계획된 경로를 반영하여 목적지를 설정(move_base_simple_goal)하고 실제 로봇을 이동시키는 기능(move_base_action)이 있다.

2.3 SLAM 기술을 활용한 2차원 지도 작성

SLAM (Simultaneous localization and mapping)이란 동시적 위치추정 및 맵핑을 의미하는데, 로봇이 이동하면서 라이다 센서를 통해 얻어지는 점군 데이터와 추가적인 센서들을 융합하여 위치를 인식하는 동시에, 이동하는 경로에 대한 맵을 작성하는 기술이다. Fig. 4는 SLAM 기법의 이론적인 개념도를 나타낸다. 여기서 Xk는 k 시간에서 로봇의 위치를 나타내고 Uk는 Xk를 결정하는 요인들을 나타낸다. m(i, j)는 시간과 관계없이 로봇이 탐색한 랜드마크를 나타내며, zk는 특정 시각 k에서 로봇이 탐색한 랜드마크를 나타낸다. 즉, 로봇은 이동하는 동안 센서들을 통해서 주변에 있는 특징점들을 인식하고 특징점과 현재 예상되는 위치와 특징점의 상대적인 위치 차이를 계산하여 실제 위치에 가장 근접하게 예상한다(Dissanayake et al., 2001). 본 연구에서는 ROS 환경에서 SLAM 기술을 적용하기 위해 gmapping 패키지를 활용하였다.

2.4 AMCL 기법을 활용한 위치추정

AMCL (Adaptive Monte Carlo Localization)은 로봇의 위치를 추정하고 보정하기 위해 사용되는 알고리즘 중 하나이다. 라이다 데이터로부터 입력받은 포인트 데이터에 파티클 필터를 적용하여 로봇의 위치를 확률적으로 예상한다. 로봇의 불확실성을 최소화하기 위해서 사전에 만들어진 맵과 현재 라이다 데이터를 실시간으로 비교하고 유사도를 계산하여 위치에 대한 가중치를 부여한다. 이와 같은 방법을 통해 로봇이 있을 수 있는 확률이 낮은 지역에는 가중치를 낮추고, 확률이 높은 지역에는 가중치를 높이는 방법을 반복하면서 로봇의 위치를 보정한다(Li et al., 2019). 본 연구에서는 실내 복도를 대상으로 실험을 수행하였기 때문에 로봇이 직선 구간을 주행할 때 보다 꺾이는 구간이나 주변 사물이 돌출된 지역에서 상대적으로 AMCL 기법 성능이 향상되는 것을 확인할 수 있었다.

2.5 모바일 로봇의 자율주행 시스템 구성

Fig. 5는 ROS를 통해 개발된 자율주행 시스템의 전체적인 데이터 흐름도를 나타낸다. 자율주행 시스템은 크게 3가지(인지(perception), 계획(planning), 제어(control))의 파트로 구성된다. 우선, 인지(perception) 파트에서는 라이다, 엔코더 센서로부터 실시간으로 거리 데이터와 로봇의 바퀴 회전수를 입력받고 이를 통해 로봇의 위치를 추정한다. 또한, 거리 데이터로부터 전방의 장애물 여부를 확인한다. 계획(planning) 파트에서는 입력받은 경유지(waypoint)를 기반으로 최적 이동 경로를 계획한 후 전역 코스트 맵(global costmap)과 국부 코스트 맵(local costmap)으로부터 주행 가능 영역을 인지한 후 로봇의 이동 경로에 대해 전역 계획(global path plan) 및 국부 계획(local path plan)을 수립한다. 제어(control) 파트에서는 모든 경로계획이 반영된 위치로 로봇을 이동시키기 위한 속도와 조향을 계산한 후 실제 로봇의 모터를 제어하여 로봇을 이동시킨다. 위의 과정은 실시간으로 주변 상황을 반영하여 업데이트된다.

3. 실내 주행 실험 방법

3.1 실내 실험장 구성

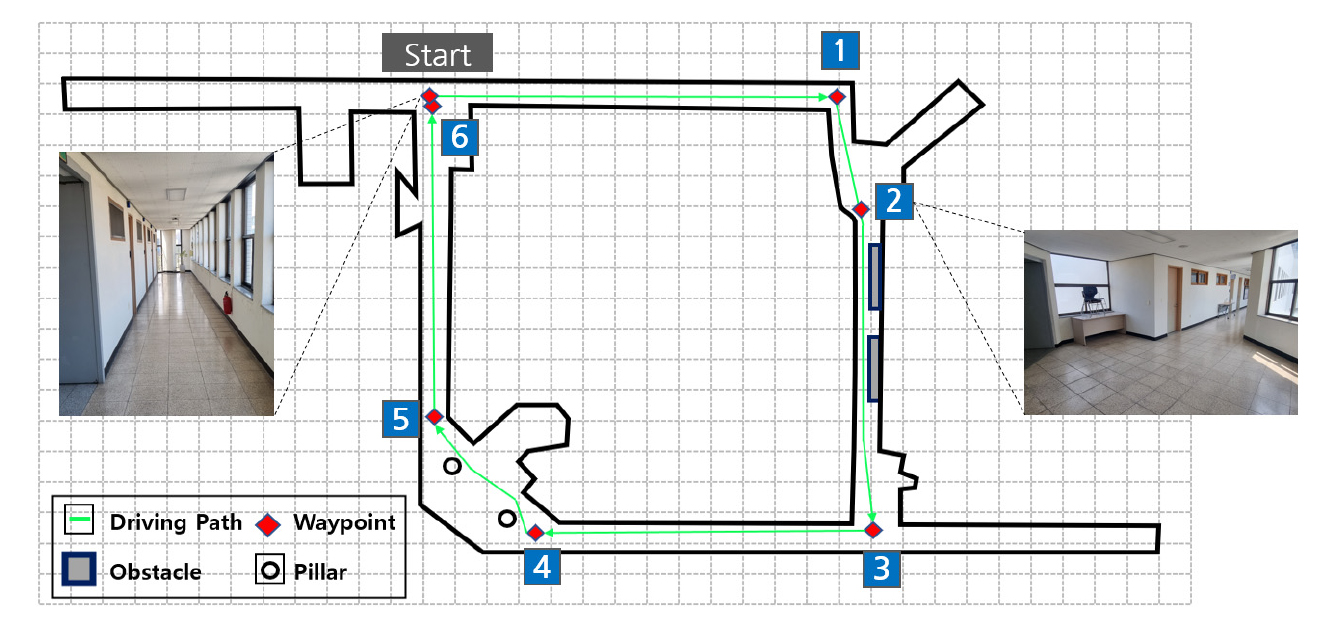

개발된 자율주행 로봇의 주행 테스트를 수행하기 위해서 Fig. 6과 같이 건물의 복도를 대상으로 실내 실험장을 구성하였다. 실험지역은 건물 복도 한 층을 주행하면서 원점으로 복귀하는 형태로 설계하였다. 총 6개의 경유지를 순차적으로 이동하도록 설계하였으며, 직선 120 m 거리를 주행한다. 도로 측면 일부 지역에 높이 약 70 cm, 폭 150 cm의 탁자형 장애물을 배치하면서 갱도 측면에 정차된 차량에 대해 회피 기능을 테스트하였으며, 지하광산에서 빈번하게 존재하는 기둥 형태의 장애물에 대한 회피 기동 능력도 함께 확인할 수 있도록 경로를 계획하였다.

3.2 주행 실험 방법

전체 실험지역을 원격 조종하면서 SLAM 기술을 통해 전체 실험지역에 대한 맵을 생성한다. 만들어진 맵에 총 6개의 경유지를 설정한 후 로봇이 자율주행하며 복귀하는 동안 엔코더를 통해 추정한 위치 좌표와 엔코더와 라이다 센서의 데이터를 AMCL 기법으로 보정한 위치 좌표를 저장한다. 6지점의 경유지에 로봇이 도착하였을 때, 실제 로봇의 위치와 추정된 로봇의 위치를 비교하여 위치추정 정확도를 정량적으로 평가한다. 또한, 로봇이 주행하는 동안 장애물 충돌 여부를 확인하여 장애물 회피 기능에 대해 검증하고자 한다. 실험을 수행하는 동안 자율주행 로봇은 엔코더와 라이다를 함께 사용한 위치추정 결과를 바탕으로 주행하며, 위치 보정의 성능을 확인하기 위해 엔코더만을 통해 추정된 위치 데이터를 저장한 후 함께 비교하였다.

4. 실험 결과

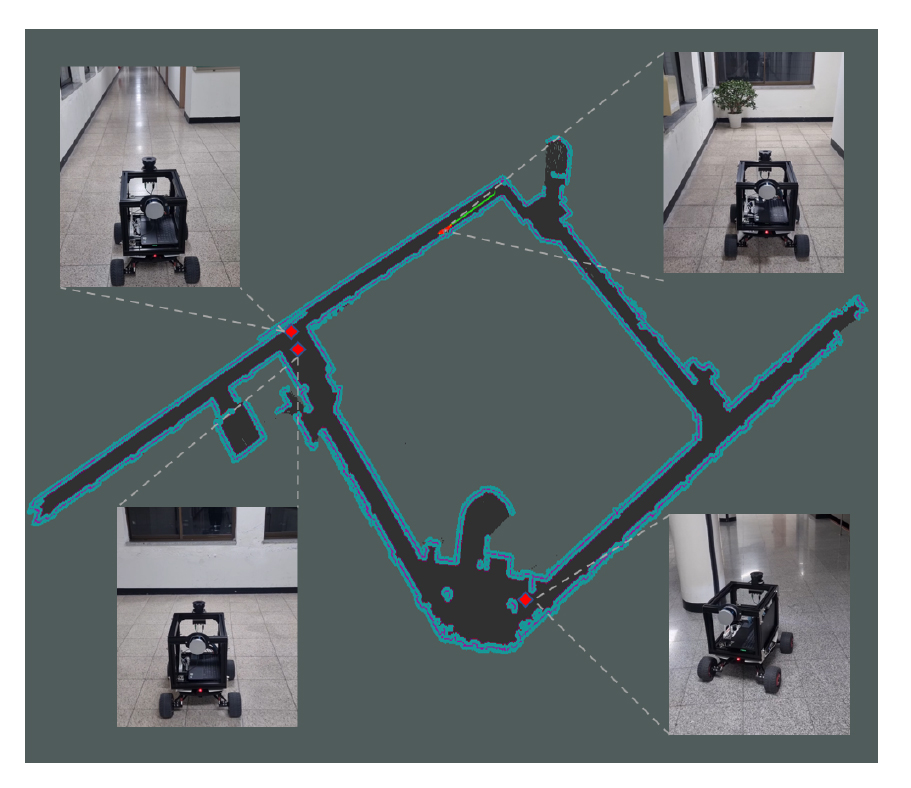

Fig. 7은 SLAM 기술을 활용하여 만든 2차원 맵에서 실제 로봇이 주행하는 모습을 나타낸다. 작성된 맵에서 유리 재질의 벽면에 의해 라이다 센서의 레이저 빛이 투과되는 일부 영역은 맵 데이터가 불완전하여서 후처리 작업을 통해 맵 데이터를 수정하여 주었다. 자율주행 로봇은 출발지점에서 주행을 시작한 후 6개의 경유 지점들까지 순차적으로 경로를 생성하고 위치를 추정하며 자율주행하는 것을 확인할 수 있었다. 또한, 기둥 형태의 장애물이 있는 지역에서는 이를 인지하고 로봇이 안전하게 회피 기동하는 것을 확인할 수 있었다. 기둥 형태의 장애물이 있는 지역에서 벽면 추종 기법을 활용하였다면 경유 지점에 원하는 자세로 도착하지 못할 확률이 높다. 그뿐만 아니라 단순하게 벽면만을 따라서 주행하기 때문에 로봇이 두 개의 기둥 사이를 통과할 때 우측에 있는 공간을 따라 진입하였을 수도 있다. 특히, 벽면의 형태가 불분명한 지형에서는 벽면 추종 기법에 비해 경유지 주행 기법의 활용도가 더욱 높아질 것이라고 예상할 수 있었다.

Fig. 8은 로봇이 주행하는 동안 2가지의 위치추정 방법을 통해 추정된 로봇의 이동 경로를 나타낸다. 시작점에서 위치추정 방법들은 각각의 좌표계를 가지기 때문에 이를 맞추어 주기 위해 엔코더 센서에서 얻은 데이터들을 일정량만큼 회전이동해 주었다. 실험 결과 실제 실험장이 X, Y축 방향으로 수직인 것을 반영하였을 때, 엔코더와 라이다의 데이터를 함께 사용한 위치추정 방법이 엔코더만을 사용한 위치추정 방법보다 상대적으로 정확한 것이라 예상할 수 있었다. 뿐만 아니라, 출발한 위치로 복귀하였을 때의 위치 좌표 또한 두 개의 센서를 함께 사용한 방법이 상대적으로 정확한 것으로 확인할 수 있었다.

엔코더 센서만을 통해 위치를 추정한 경우 일부 구간에서 직선 방향으로 움직였음에도 왼쪽으로 틀어진 후 그 방향을 따라 직진한 것으로 인식되었다. 추정된 경로가 좌측으로 틀어졌다는 것은 좌측 바퀴의 회전수가 우측 바퀴의 회전수보다 상대적으로 많은 것이다. 이는 로봇이 직진할 때 좌측 바퀴가 우측 바퀴와 거의 동일한 양만큼 회전해야 하지만 좌측 방향의 바퀴가 지면과 발생한 미끄러짐 현상(slip)에 의해 실제로 로봇이 좌측으로 이동하지 않았음에도 이동한 것으로 추정된 것이다. 특히, 이와 같은 미끄러짐 현상은 로봇이 경유 지점에 도착한 후 제자리에서 회전할 때 크게 발생하였다. 반면, 엔코더와 라이다를 함께 사용한 방법의 경우 엔코더에 의해 발생하는 오차를 라이다 데이터와 맵을 매칭하면서 보정해주기 때문에 오차가 적게 나타난 것으로 판단된다.

Fig. 9는 실내 실험을 수행하는 동안 X, Y 방향의 위치를 나타낸다. 두 종류의 위치추정 방법은 초반에는 전반적으로 비슷한 경향을 보였지만 엔코더 센서만을 사용한 경우 X 방향에서 로봇이 이동하지 않은 음의 방향으로 로봇이 이동한 것으로 인식되었고, Y 방향의 경우 최대 10 m 가량 오차가 발생하는 것을 확인할 수 있었다. 또한, 엔코더 센서를 통해 위치를 추정한 경우 로봇이 원점에 도달하였을 때도 원점의 좌표(0,0)와 다소 차이 나는 것으로 보아 이동 경로의 오차가 상대적으로 크게 누적되는 것을 확인할 수 있었다. 결과적으로 두 개의 센서를 모두 사용한 위치추정 방법이 더 높은 위치추정 정확도를 보였다.

Table 3은 자율주행 로봇이 6지점의 경유지에 도착하였을 때, 엔코더, 라이다를 통해 추정한 위치 좌표와 로봇의 주행환경을 촬영한 동영상에서 로봇의 실제 위치를 비교한 표를 나타낸다. 전체적으로 X, Y 방향 모두 첫 번째 경유지에서는 거의 오차를 보이지 않지만, 로봇이 계속 이동할수록 위치 오차가 누적되어 발생하는 것을 확인할 수 있었다. 전체 실내 실험장의 직선 이동 경로인 120 m를 주행하는 동안 위치추정의 평균 제곱근 오차(Root mean square error, RMSE)는 약 0.45 m 발생한 것을 확인할 수 있었다.

Table 3.

Results of location estimation method using encoder and LiDAR from indoor experiments of autonomous driving robot

| X (m) | Y (m) | |||

| Estimated | Actual | Estimated | Actual | |

| 1 | 26.87 | 26.95 | -0.13 | 0 |

| 2 | 31.25 | 31.30 | -9.12 | -8.95 |

| 3 | 31.06 | 31.30 | -31.49 | -31.65 |

| 4 | 7.55 | 7.95 | -31.81 | -31.30 |

| 5 | 1.17 | 0.35 | -24.33 | -23.45 |

| RMSE | 0.42 | 0.47 | ||

5. 결 론

본 연구에서는 ROS 기반의 지하광산용 자율주행 로봇을 개발하였고 여러 경유지를 순차적으로 주행하고 복귀하는 실내 테스트를 수행하였다. 개발된 자율주행 로봇은 라이다, 엔코더와 같은 센서들을 탑재하여 자체적인 위치추정, 장애물 회피 기능을 탑재하였다. 또한, SLAM 기술을 활용하여 실험지역에 대한 2차원 맵을 작성하였고, AMCL 기법을 활용하여 로봇의 위치를 보정해 주었다. 실내 실험장을 대상으로 테스트를 수행한 결과, 자율주행 로봇은 6지점의 경유지들을 안정적으로 주행하고 복귀하는 것을 확인할 수 있었다. 또한, 약 120 m를 주행하는 동안 평균적으로 0.45 m의 위치추정 오차를 보이며 안정적인 위치추정 성능을 확인할 수 있었다.

기존 국내 광업 분야에서 수행된 자율주행 로봇을 활용한 연구들에서는 갱도의 벽면을 추종하는 형태로 자율주행을 수행하였는데, 교차로나 여러 지점이 만나는 지역에서 로봇의 경로 선택이 어렵다는 한계점이 있었다. 또한, 갱도 내에 주행 경로를 지시하는 도로 표식지를 배치한 후 이를 비전 시스템으로 인식하여 로봇의 경로를 결정해주는 연구도 수행되었다(Kim and Choi, 2021). 그러나, 표식지를 활용하기 위해서는 경로를 변경할 때마다 사람이 직접 갱도 내에 투입되어야 하는 어려움이 있었다. 그러나 본 연구에서는 사전에 작성한 맵을 통해 원하는 지점에 경유지를 설정하고 로봇이 투입되어 주행한 후 자동으로 복귀하는 시스템을 적용하였기 때문에 전반적인 작업 효율이 올라간다는 장점이 있었다.

실제 지하광산의 경우 지면이 평평하지 않고 울퉁불퉁하다. 또한, 도로의 경사면이나 거칠기에 따라 위치추정 및 자율주행의 성능이 영향을 받을 수 있다. 따라서 향후에는 실내뿐만 아니라 지하광산 현장에서 로봇의 자세나 방향이 불규칙하게 변할 때 센서들의 측정 정확도에 대한 평가가 수행되어야 할 것이다. 또한, 로봇이 주행하는 동안 바닥 면과 로봇의 바퀴 사이의 미끄러짐 현상에 의해 위치추정 성능 저하가 발생한 것으로 예상하였으나, 실제 로봇 바퀴에서 슬립 발생이 아닌 다른 이유로 오차가 발생하였을 수도 있어서 같은 경로를 대상으로 반복실험을 수행한 후 슬립의 발생 여부 및 경향성 등을 분석할 필요가 있다. 슬립에 의해 발생한 오차를 개선하기 위해서는 IMU (Inertial Measurement Unit) 센서와 같은 자세 측정 장비를 추가로 탑재하여 실제 갱도 내에서 발생할 수 있는 위치 오차를 최소화해야 할 것이다.

개발된 자율주행 로봇은 SLAM 기술을 통해 사전에 확인된 정적 장애물만 회피하면서 주행하였지만, 실제 갱내에서는 작업자, 차량과 같이 실시간으로 움직이는 동적 장애물이 있다. 향후에는 실험 환경을 구성할 때 이와 같은 점들을 반영하여 실시간 객체 인식 및 장애물 회피 기능을 검증하여야 할 것이다. 그뿐만 아니라 본 연구에서는 로봇이 여러 지점을 순차적으로 주행한 후 복귀하는 기능만을 활용하였지만, 실제 지하광산에서 자율주행 로봇의 활용도를 높이기 위해서는 갱내의 온도, 습도, 분진 농도와 같은 환경인자들을 측정할 수 있는 센서들을 추가로 탑재하여야 할 것이다.